Enfin les salons reprennent!

Après ces 2 années de covid, les choses se remettent en place.

La dernière fois, j’avais découvert l’offre Amazon dans son cloud; cette fois, j’ai rencontré différents éditeurs proposant des offres intégrées à AWS ainsi que des retours clients toujours riches en partage.

Focus sur ce qui m’a marqué dans cette édition

Côté éditeur

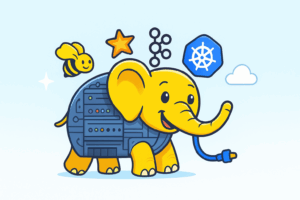

J’ai découvert (redécouvert plutôt) Druid.

Druid est une base de données orientée décisionnel. En mode Hadoop, cela tourne sur plusieurs datanode, fait pas mal de cache (concept in memory), aide à faire des cubes, etc… Je connaissais ce produit sur Hadoop mais je ne l’avais pas mis en oeuvre car il peut consommer pas mal de ressources et c’est pour moi un choix d’architecture à faire en début de projet Datalake.

Voici donc la version rajeunie sur AWS.

Une IHM puissante s’appelle Imply. Elle permet la restitution, des Dashboard, l’administration et le déploiement automatique sur AWS (Il suffit de définir un nombre d’instance EC2 et le produit s’occupe de tout).

Druid est aussi une base orientée TimeSeries (à voir si cela ressemble à Prometheus) et l’interface Imply permet de gérer tout cela.

Clairement voici un beau produit, mature (Druid existe depuis Hadoop) qui mérite d’être testé.

Côté retour d’expérience

J’ai assisté à la présentation du DSI de Bouygues Télécom.

Belle roadmap ambitieuse chez AWS

De quoi parle t’on?

Bouygues a développé un produit de centralisation des logs de tous ses serveurs. Il s’agit de quelque chose comme 500TB.

Deux briques structurantes:

- Confluent Kafka (en mode service)

- Kafka permet l’asynchrone

- Suite ELK cloud

- Nous allons nous y intéresser un peu

Elastisearch permet l’indexation des données (ici de logs). En mode cloud, leurs développeurs ont ajouté une couche de machine learning capable d’analyser des métriques et un débit. Il est alors possible d’alerter sur un changement d’activités, de détecter des anomalies.

Le classique LogStash est un agent qui collecte les logs et ici, alimente Kafka avant d’arriver sur Elastic.

Kibana est la partie visualisation pour concevoir des dashboard, des suivis de production, etc…

Chez Bouygues, nous parlons d’un cluster d’environ 50 noeuds. Ils utilisent aussi Grafana au passage.

Leur projet est d’utiliser l’analyse des logs pour réparer automatiquement tout dysfonctionnement. Leur produit de centralisation permet déjà de contrôler voir d’assurer les mises en production.