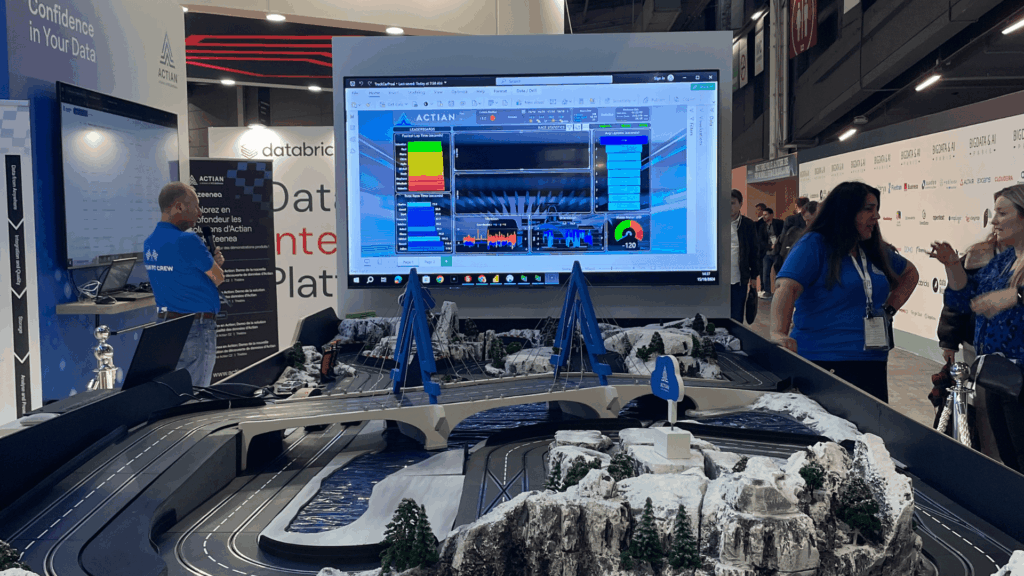

Cette édition a déménagé au parc des expositions à porte de Versailles.

Cela m’a donné l’impression d’être plus petit et d’avoir moins de personnes que les années passées; en fait c’est l’inverse.

Les espaces pour les ateliers sont plus facilement accessibles car regroupés d’un côté du salon. Avant il étaient aux 4 coins ce qui rendait difficile de passer d’un atelier à l’autre sans perdre au moins 10 minutes.

Qu’est ce qui change cette année ?

L’an dernier était l’arrivée de ChatGpt; il était partout et tous les éditeurs ne parlaient que de ça. Cette année, une certaine maturité s’est produite; pas mal d’organisations ne veulent pas d’ouverture sur internet et préfèrent une IA « on premise ».

Les éditeurs proposent des solutions avec plusieurs modules d’IA.

Quels sont les acteurs qui m’ont marqué cette année ?

Timi

C’est toujours un plaisir de croiser son fondateur.

Il y a quelques années, il avait fait un travail extraordinaire de reverse engineering et réécrivant le format parquet. Il avait ensuite développer un outil analytique sur PC permettant de manipuler en mémoire de grandes quantités de données.

Cette année son offre analytique s’est étendue et c’est devenu une plateforme IA performante

Neo4j

Pour moi le graphe, c’est l’avenir. J’avais parlé d’eux l’an dernier; leur offre qui inclut stockage et indexation et gestion de cluster est de loin la meilleure du marché.

Par définition un graphe est le meilleur moyen de stocker la connaissance.

Dataiku

J’avais déjà travaillé avec ce produit à la Banque Postale. N’étant pas data scientiste, je m’étais attaché davantage à la connexion de ce produit sur Cloudera.

Une démo sur la création d’un modèle de machine learning m’a épaté.

Je ne sais pas jusqu’où c’est bien fait « sous le capot » mais c’est à se demander à quoi sert un data scientiste !

Je vous explique l’approche:

- vous ajoutez un modèle dans votre pipeline

- vous créez le modèle en lui fournissant une table d’entrainement avec la liste des colonnes pertinentes et la colonne à prédire; vous sélectionnez une liste de modèles

- il vous dira le modèle qui a le meilleur résultat et ça y est, vous l’utilisez en prédiction dans votre pipeline

Très franchement, j’ai repris quelques exemples en python sur Kaggle… euh c’est un peu plus complexe

Databricks

Il a fallu qu’un collègue rejoigne cette entreprise pour que j’aille faire leur connaissance.

D’un point de vue visuel, ça donne l’impression d’un PowerBi nouvelle génération:

- catalogage des données (trouver la bonne table en face d’un tableau)

- assistant pour faire des dashboards

- génération de visuels en mode « chatGpt » (décrire en langage naturel ce que l’on souhaite comme rapport)

D’un point de vue technique, le produit s’appuie sur les différentes solutions de stockage cloud, AWS S3, Azure Data Lake Storage, ou Google Cloud Storage.

Ils ont créé un format de fichiers adapté à une abstraction en tables appelé delta lake.

Ce format permet de gérer les données sous forme de tables transactionnelles avec des fonctionnalités avancées, comme l’ACID, la gestion de versions (Time Travel), et les opérations de nettoyage automatique. Delta Lake assure ainsi la fiabilité, la performance et la facilité de manipulation des données dans les projets d’analyse et de machine learning.

C’est mon coup de cœur cette année.

Village Quantique

Je ne sais pas si c’est une nouveauté mais je suis passé discuter avec les cerveaux des ordinateurs quantum.

J’ai donc rencontré Alice&bob, une startup française qui a déjà innové en divisant par 2 le nombre de Qubit nécessaire aux traitements.

Nous sommes dans le monde de la recherche; bon les ordinateurs quantiques, les concepts de supra conducteurs, une logique binaire à 3 états, les concepts de superposition… je suis un peu largué.

En revanche, on évoque souvent cette technologie comme un moyen de cracker des codes ou des protocoles de sécurité comme rsa.

J’ai appris que certains stockent aujourd’hui des trames réseaux dans l’espoir de les décoder le jour où un ordinateur quantique saura les cracker.

Nous sommes à horizon 10 ans mais tous les acteurs sont bien présents.

En synthèse

Ce rendez-vous annuel est un immanquable; cela permet de constater les tendances du marché dans le monde du big data, de retrouver un paquet de collègues et éditeurs et enfin de passer un moment convivial et direct avec cette communauté.

Vive le rock, vive le big data.